Il messaggio chiave del 2026 non è che l’AI stia diventando più intelligente, ma che le aspettative stanno diventando più definite. Il 14 gennaio 2026, EMA e FDA hanno pubblicato principi guida congiunti sulle buone pratiche di utilizzo dell’AI nello sviluppo dei farmaci. Si tratta di un segnale di allineamento regolatorio su ciò che costituisce “buona pratica” quando l’intelligenza artificiale supporta la generazione di evidenze lungo l’intero ciclo di vita del prodotto, inclusi gli studi clinici e le attività di monitoraggio della sicurezza.

Questi principi non rappresentano un nuovo insieme di regole. Sono un punto di riferimento su come l’AI debba essere applicata all’interno dei processi regolamentati. Le linee guida sono tecnologicamente neutrali, ma specifiche dal punto di vista operativo: definire il contesto d’uso, applicare controlli basati sul rischio, governare dati e documentazione e gestire il sistema lungo tutto il suo ciclo di vita affinché la supervisione rimanga integra. Vanno interpretate come un passaggio da “possiamo usare l’AI?” a “possiamo far funzionare l’AI in modo affidabile, trasparente e responsabile?”

Perché è importante: la conversazione sta passando dalla capacità al controllo

Negli ultimi 18–24 mesi, molte aziende del settore Life Sciences hanno esplorato l’uso dell’AI in casi d’uso “ad alta densità testuale” e di tipo assistivo: sintetizzare documenti estesi, classificare contenuti, estrarre punti dati e redigere testi interni o esterni. Si tratta di un punto di partenza logico perché permette una sperimentazione rapida ed è semplice dimostrare il valore generato.

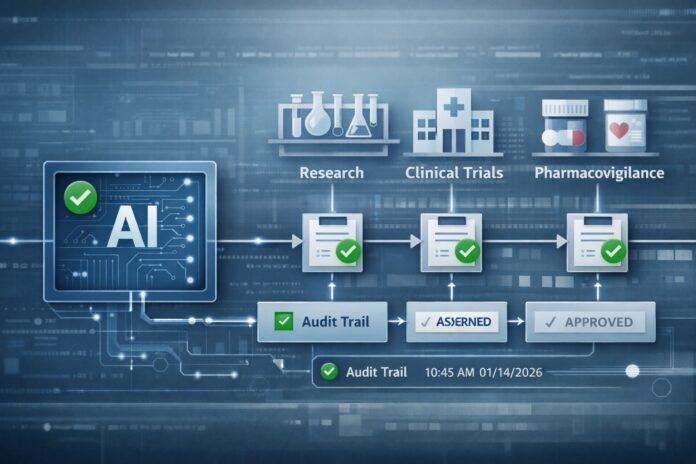

Il passaggio più complesso è ciò che viene dopo. Nel momento in cui l’output dell’AI inizia a influenzare evidenze regolamentate, decisioni o azioni, “sembra funzionare” non è più uno standard accettabile. Lo standard sta evolvendo verso un modello ripetibile e soggetto a supervisione: utilizzo coerente nel proprio contesto, responsabilità chiaramente definita con un intervento umano nel ciclo (‘human in the loop’) e una tracciabilità che resista nel tempo alle verifiche ispettive. È proprio questo che i principi EMA–FDA rendono più evidente.

Il contesto d’uso diventa l’elemento cardine

La frase più rilevante nel quadro delineato dalle autorità regolatorie è “contesto d’uso”. L’AI non viene valutata in astratto. Viene valutata in relazione a ciò che è progettata per fare, a ciò che influenza e al rischio che introduce.

Un assistente di redazione utilizzato per sintetizzare note interne rappresenta un certo livello di impiego. Un sistema di AI che utilizza lo stesso metodo di sintesi per prioritizzare la revisione dei casi di safety, identificare potenziali segnali oppure attivare passaggi operativi in uno studio clinico rappresenta tutt’altro livello. La medesima tecnica di base può passare da un impatto basso a un impatto elevato semplicemente in funzione della posizione che occupa nel processo e del modo in cui il suo output viene utilizzato.

Questa differenza è rilevante perché modifica ciò che, nella pratica, viene richiesto come “buona prassi”. Quando il contesto d’uso comporta un rischio più elevato, anche le aspettative regolatorie e operative si innalzano: controlli più chiari, documentazione più robusta, supervisione umana esplicita e una gestione delle modifiche più rigorosa. La conseguenza pratica è che i programmi di AI avranno sempre più bisogno di un inventario dei casi d’uso mappato in base al rischio, con confini operativi ben definiti e una comprensione condivisa delle responsabilità.

L’elemento su cui si fonda la fiducia non è il modello in sé, ma il workflow in cui opera e il record che genera

I principi guida sono tecnologicamente neutrali, ma non sono neutrali rispetto alla loro esecuzione. Nella pratica, questo amplia l’attenzione oltre il modello in sé, includendo i controlli e la documentazione che lo circondano: la provenienza dei dati, il versioning, le modalità con cui gli output vengono revisionati e utilizzati e ciò che è cambiato nel tempo.

È qui che una scelta strategica di design diventa critica: decidere se l’AI debba rimanere al di fuori del workflow regolamentato come strumento separato, oppure se debba essere integrata all’interno dei sistemi in cui il lavoro regolamentato viene effettivamente svolto.

Quando l’AI è integrata in un workflow regolamentato, può ereditare automaticamente ciò che tali ambienti richiedono: autorizzazioni basate sui ruoli, passaggi standardizzati, handoff controllati e audit trail progettati nativamente. Quando invece l’AI rimane al di fuori del workflow regolamentato, i team finiscono spesso per ricostruire il contesto e i controlli a posteriori: copiare informazioni tra strumenti diversi, riconciliare versioni e ricostruire la “storia del record” durante revisioni e ispezioni. Questo approccio può essere gestibile in un pilot, ma è estremamente fragile quando si scala.

Questa direzione “embedded” è anche quella verso cui si sta orientando la strategia di prodotto del settore. Veeva, ad esempio, ha delineato un rollout graduale di AI agent che parte dalle applicazioni commercial e si estende a R&D e Quality nel corso del 2026. Ciò riflette un principio più ampio: integrare l’AI in profondità all’interno dei sistemi operativi di record è strutturalmente più allineato a dati governati, auditabilità e supervisione ripetibile rispetto a trattare l’AI come un livello esterno separato.

La gestione del ciclo di vita smette di essere opzionale quando l’AI entra nei workflow regolamentati.

La gestione del ciclo di vita può sembrare un concetto astratto finché non la si collega al modo in cui l’AI si comporta in produzione.

I modelli fondazionali di nuova generazione vengono rilasciati. I prompt derivati dagli obiettivi e dalle istruzioni degli agenti evolvono. Le fonti di conoscenza e i dati transazionali cambiano.

Ognuno di questi cambiamenti può modificare in modo sottile l’output dell’AI, in modi che risultano significativi in un contesto regolamentato. L’enfasi dei regolatori sulla valutazione delle prestazioni basata sul rischio e sulla gestione del ciclo di vita è, in pratica, un promemoria che “impostare e dimenticare” non è un’opzione nel momento in cui l’AI influenza attività regolamentate.

Che cosa significa, in termini operativi, “gestione del ciclo di vita”?

- Version control rilevante ai fini ispettivi: non solo per codice e modelli, ma anche per prompt, istruzioni degli agenti, template e materiali di riferimento che influenzano gli output.

- Monitoraggio definito e trigger di drift: cosa monitorare, con quale frequenza e cosa costituisce un cambiamento significativo.

- Change control proporzionato al rischio: quando una modifica richiede documentazione, revisione, ri‑qualificazione o rollback.

- Responsabilità chiaramente definita quando l’output dell’AI viene accettato, corretto o sottoposto a escalation: affinché la responsabilità non si dissolva nel “lo ha detto l’algoritmo”.

Si tratta di discipline dell’operating model. Non sono componenti opzionali da delegare a un team di data science. Vivono all’intersezione tra qualità, ownership dei processi di business e tecnologia, esattamente il punto in cui risiede già l’esecuzione regolamentata.

La spinta regolatoria sta convergendo con le aspettative operative

I principi EMA–FDA si inseriscono in un più ampio movimento regolatorio che rafforza lo stesso messaggio di fondo: una tecnologia affidabile richiede un’esecuzione affidabile.

In Europa, la tempistica definita dalla Commissione Europea per l’AI Act rende sempre più concreti i requisiti di governance, con l’applicazione completa prevista per il 2 agosto 2026, accompagnata da milestone precedenti relative alle pratiche vietate e alla AI literacy (dal 2 febbraio 2025) e agli obblighi per l’AI di uso generale (dal 2 agosto 2025).

Negli Stati Uniti, la guida FDA di ottobre 2024 sui sistemi elettronici, le registrazioni elettroniche e le firme elettroniche nelle sperimentazioni cliniche chiarisce cosa significhi che record e sistemi elettronici siano affidabili e robusti. Non è una guida sull’AI, ma diventa direttamente rilevante quando l’output dell’AI contribuisce alla generazione di evidenze.

Se l’AI influenza evidenze e decisioni, l’integrità del record elettronico e del sistema che lo produce diventa più centrale, non meno.

Nulla di tutto ciò suggerisce che le autorità vogliano rallentare l’innovazione. I principi congiunti sono formulati esplicitamente per abilitare un uso responsabile. L’asticella operativa si sta alzando in un modo che premia le organizzazioni capaci di rendere la supervisione pratica, ripetibile e scalabile.

Cosa dovrebbero fare ora i leader

La risposta pratica non è rallentare l’adozione dell’AI. È renderla operativa, così che ogni nuovo caso d’uso non faccia ripartire da zero un nuovo dibattito sulla governance.

Per la maggior parte delle organizzazioni, l’opportunità nel breve termine consiste nell’utilizzare i principi EMA–FDA come requisito di design per l’ambiente operativo dell’AI, anche mentre le funzionalità dei prodotti a supporto di ambiti clinical, regulatory e safety continuano a maturare sul mercato. Ciò significa svolgere il lavoro fondamentale necessario per passare da applicazioni AI isolate a una capability governata all’interno di un ambiente di esecuzione regolamentato. Questo comporta definire i contesti d’uso, mapparli in base al rischio, standardizzare cosa debba costituire l’“informazione essenziale” per la supervisione e applicare controlli di lifecycle a ciò che cambia e a quando cambia.

Questo è anche il momento per chiedere maggiore specificità ai vendor. Non “fa AI?”, ma: dove si colloca l’AI nel workflow, quale record produce, cosa viene versionato, cosa è auditabile, cosa è monitorato e cosa cambia sotto change control? Maggiore è l’integrazione dell’AI nei sistemi che già gestiscono ruoli, autorizzazioni, workflow e audit trail, più semplice diventa scalare in modo responsabile nel tempo, senza dover ricostruire evidenze e supervisione da zero.

Operationalizzare l’AI per ambienti GxP

I principi EMA–FDA stanno cambiando il modo in cui il settore affronta l’AI: non come componente aggiuntiva separata, ma come parte della base regolamentata per la generazione e il monitoraggio delle evidenze. Le organizzazioni di successo non saranno quelle che conducono il maggior numero di pilot. Le biopharma che integreranno l’AI in workflow controllati, dove le decisioni sono revisionabili e tracciabili e i cambiamenti possono essere gestiti con supervisione, saranno quelle in grado di trasformare l’investimento in AI in un reale vantaggio operativo.